如果产品的核心价值在于通过独特的数据来为用户定制个性化体验,你很难快速地设计一个具有真实感的原型。但是,如果你等ML系统建完再去测试它的设计,可能就没机会改了。

不过,有两种用户研究方法可以解决这个问题:使用参与者建立个人示例、Wizard of Oz研究。

在使用早期模型进行用户研究时,可以让参与者带一些他们自己的数据来,比如个人照片、通讯录、他们收到的音乐或电影建议等。当然,要让参与者完全明白他们的数据将被用来干什么、什么时候才会被删除。

对于参与者来说,这可能是一个很有意思的家庭作业。

通过这些示例,你可以模拟系统的正确、错误响应。比如说你可以模拟系统向用户返回错误的操作建议,查看用户的反应,了解他对错误原因的假设。

和虚拟示例或者概念描述相比,这可以帮你更可靠地评估各种可能性的成本和收益。

还没造出来的机器学习产品的第二种测试方法,是Wizard of Oz研究。过去20年间,Wizard of Oz研究在用户研究方法中的重要性越来越低,现在,它回归了。

Wizard of Oz?绿野仙踪?

这种测试指的是由一名产品团队人员代替系统,向用户做出反馈。

△ 聊天界面是Wizard of Oz测试最简单的方法之一,只要在另一端准备一名产品人员,假装“AI”来输入回复。

让产品团队人员模仿机器学习系统的行为,比如回复聊天信息、给出呼叫建议、电影建议,可以帮用户模拟体验与“智能”系统的交互。

这些交互可以为产品设计提供关键的指导,因为当参与者认真地与“AI”交互的时候,他们会自然形成系统的新力模型,根据模型来调整自己的行为。

观察他们的对系统的适应、与系统的二次交互,对于产品设计有重大的参考价值。

4. 衡量假正类和假负类的成本

你的机器学习系统会犯错。了解这些错误是什么样的,以及它们如何影响用户的产品体验很重要。

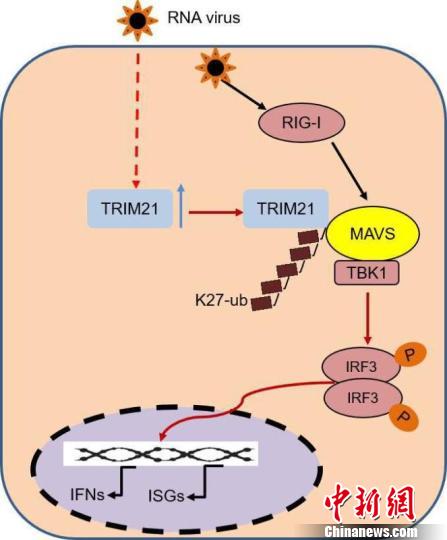

我们在第二点中提到了混淆矩阵。这在机器学习中是一个关键的概念,描述了当机器学习系统正确或者错误的时候是什么样子。

△ 混淆矩阵的四个状态,以及对用户意味着什么

对于机器来说,所有的错误都一样,但对人来说却不是这样。

例如,如果我们有一个“人类or魔怪”分类器,意外把人识别成魔怪。这只是系统的一个错误,不涉及侮辱或者文化因素考量。机器不会明白,人被错误的识别为魔怪带来的侵犯感,远大于魔怪被错误识别为人。这也许就是以人为本的偏见。:)

在机器学习中,需要有意识地在准确率和召回率之间进行权衡。

也就是说,如果你认为囊括所有的正确答案更重要,那意味着也会包含更多的错误答案(优化召回率);如果想让错误答案最小化,代价是舍弃一些正确的答案(优化准确率)。

其中包括一些儿童玩耍的场景,但不在操场上。在这个案例中,召回率优先于准确率,找到所有的操场照片更重要。

5. 有计划的进化

最好的机器学习系统,应该随着用户的心智模型不断进化。

当人们与这些系统交互时,他们也在影响和调整着这个系统未来的输出;而这些调整反过来又将改变用户和系统交互的方式……(子子孙孙无穷匮也)

当然这种不断的反馈循环,既有可能是良性的,也有可能是恶性的。所以你需要注意引导用户,给出有利于自己和模型的反馈。

良性循环的一个例子就是谷歌输入法的Gboard,他能不断的进化并预测用户下一步要输入什么字,使用系统建议的人越多,给出的建议就越好。

机器学习系统都是用现有数据集训练而成,并会根据新的输入进行调整,但这些改变在发生之前都很难预测。所以我们需要同步调整用户研究和反馈策略。这意味着在产品周期中进行提前规划纵向、高个性化以及广泛的研究。

你需要规划出足够的时间,随着用户和用例的增加,对准确率和召回率进行量化测量,来评估机器学习系统的性能。当然还需要和用户坐在一起,了解他们如何使用系统,以及成功或者失败背后的心智模型。

另外,我们需要考虑如何在整个产品生命周期内,获得用户的真实反馈,以改进机器学习系统。能否设计出更好、更快的交互反馈模式,是良好的机器学习系统与优秀的机器学习系统之间的区别。

当我们谈交互时,已经习惯于把线框、mockup、原型和红线作为标志可以交付的成果。

然而,当我们谈到机器学习增强的交互时,还得指定更多,因为“标签”来了。

标签是机器学习的重要组成部分。

滚动

滚动